发布时间:2023-07-11

发布时间:2023-07-11 点击次数:

点击次数: 今年 2 月,Meta 发布的 LLaMA 大型语言模型系列,成功推动了开源聊天机器人的发展。因为 LLaMA 比之前发布的很多大模型参数少(参数量从 70 亿到 650 亿不等),但性能更好,例如,最大的 650 亿参数的 LLaMA 模型可以媲美谷歌的 Chinchilla-70B 和 PaLM-540B,所以一经发布让很多研究者兴奋不已。

然而,LLaMA 仅授权给学术界的研发人员使用,从而限制了该模型的商业应用。

因而,研究者开始寻找那些可用于商业用途的 LLaMA,UC 伯克利的博士生 Hao Liu 发起的项目 OpenLLaMA,就是其中一个比较热门的 LLaMA 开源复制品,其使用了与原始 LLaMA 完全相同的预处理和训练超参数,可以说 OpenLLaMA 完全按照 LLaMA 的训练步骤来的。最重要的一点是,该模型可商用。

OpenLLaMA 在 Together 公司发布的 RedPajama 数据集上训练完成,有三个模型版本,分别为 3B、7B 和 13B,这些模型都经过了 1T tokens 的训练。结果显示,OpenLLaMA 在多项任务中的表现都与原始 LLaMA 相当,甚至有超越的情况。

除了不断发布新模型,研究者对模型处理 token 的能力探索不断。

几天前,田渊栋团队的最新研究用不到 1000 步微调,将 LLaMA 上下文扩展到 32K。再往前追溯,GPT-4 支持 32k token(这相当于 50 页的文字) ,Claude 可以处理 100k token (大概相当于一键总结《哈利波特》第一部)等等。

现在,一个新的基于 OpenLLaMA 大型语言模型来了,它将上下文的长度扩展到 256k token,甚至更多。该研究由 IDEAS NCBR 、波兰科学院、华沙大学、 Google DeepMind 联合完成。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

图片

图片

LongLLaMA 基于 OpenLLaMA 完成,微调方法采用 FOT ( Focused Transformer )。本文表明,FOT 可以用于对已经存在的大型模型进行微调,以扩展其上下文长度。

该研究以 OpenLLaMA-3B 和 OpenLLaMA-7B 模型为起点,并使用 FOT 对它们进行微调。由此产生的模型称之为 LONGLLAMAs,能够在其训练上下文长度之外进行外推(甚至可以达到 256K),并且在短上下文任务上还能保持性能。

有人将这一研究形容为 OpenLLaMA 的无限上下文版本,借助 FOT,模型很容易外推到更长的序列,例如在 8K token 上训练的模型,可以很容易外推到 256K 窗口大小。

图片

图片

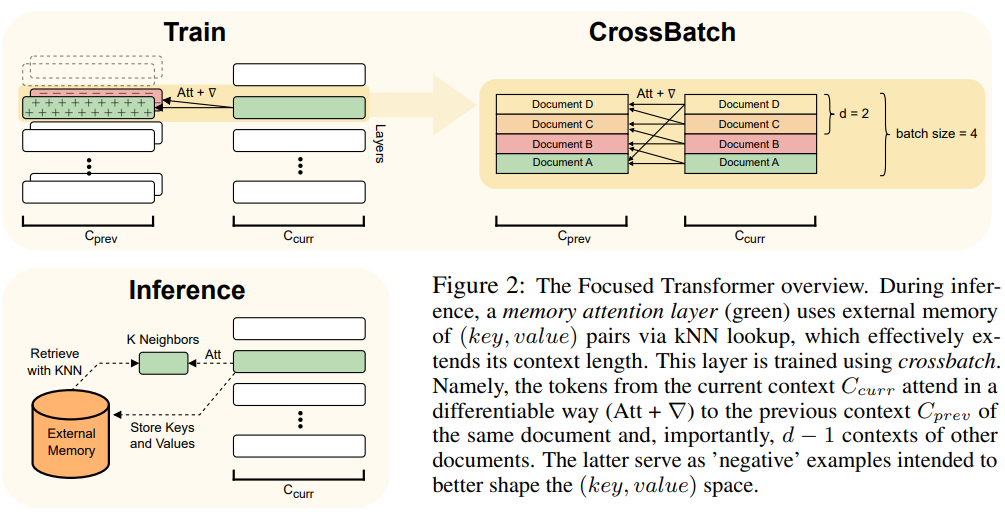

本文用到了 FOT 方法,它是 Transformer 模型中一种即插即用的扩展,可用于训练新模型,也可对现有的较大模型进行更长上下文微调。

为了达到这一目的,FOT 使用了记忆注意力层和跨批次(crossbatch)训练过程:

有关 FOT 架构的概述,请参见图 2:

图片

图片

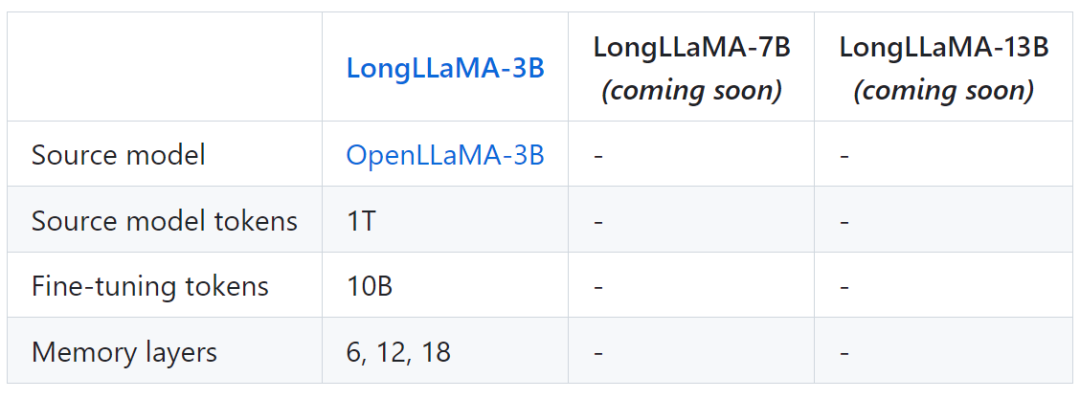

下表为 LongLLaMA 的一些模型信息:

图片

图片

最后,该项目还提供了  LongLLaMA 与原始 OpenLLaMA 模型的比较结果。

LongLLaMA 与原始 OpenLLaMA 模型的比较结果。

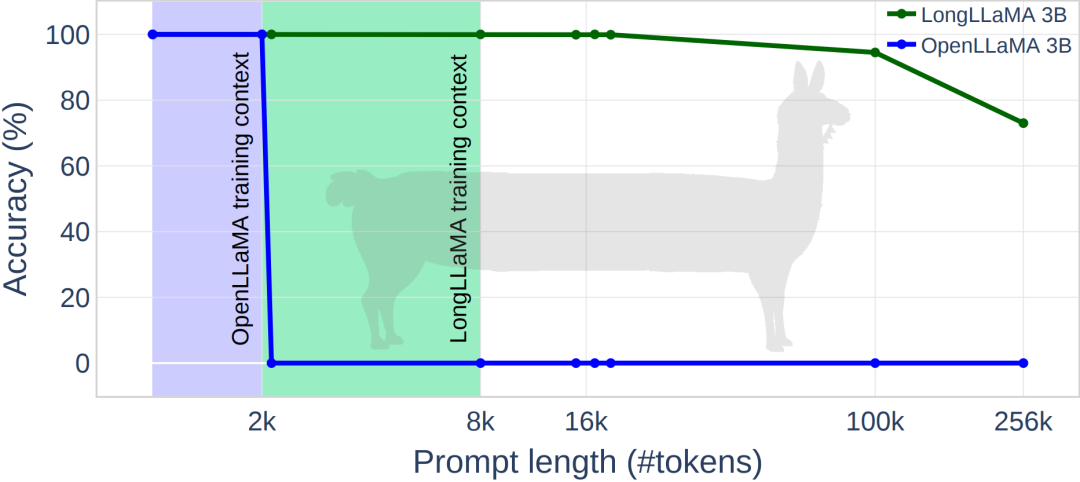

下图为 LongLLaMA 一些实验结果,在密码检索任务上,LongLLaMA 取得了良好的性能。具体而言,LongLLaMA 3B 模型远远超出了它的训练上下文长度 8K,对于 token 为 100k 时,准确率达到 94.5%,当 token 为 256k 时,准确率为 73%。

图片

图片

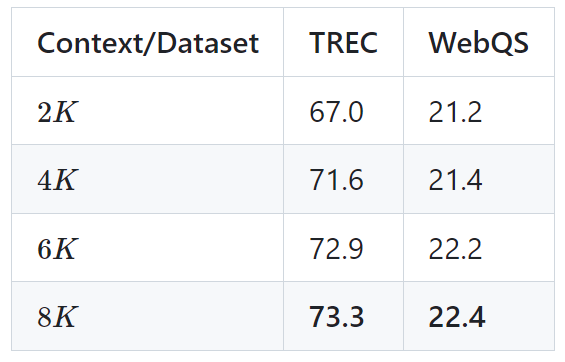

下表为 LongLLaMA 3B 模型在两个下游任务(TREC 问题分类和 WebQS 问题回答)上的结果,结果显示,在使用长上下文时,LongLLaMA 性能改进明显。

图片

图片

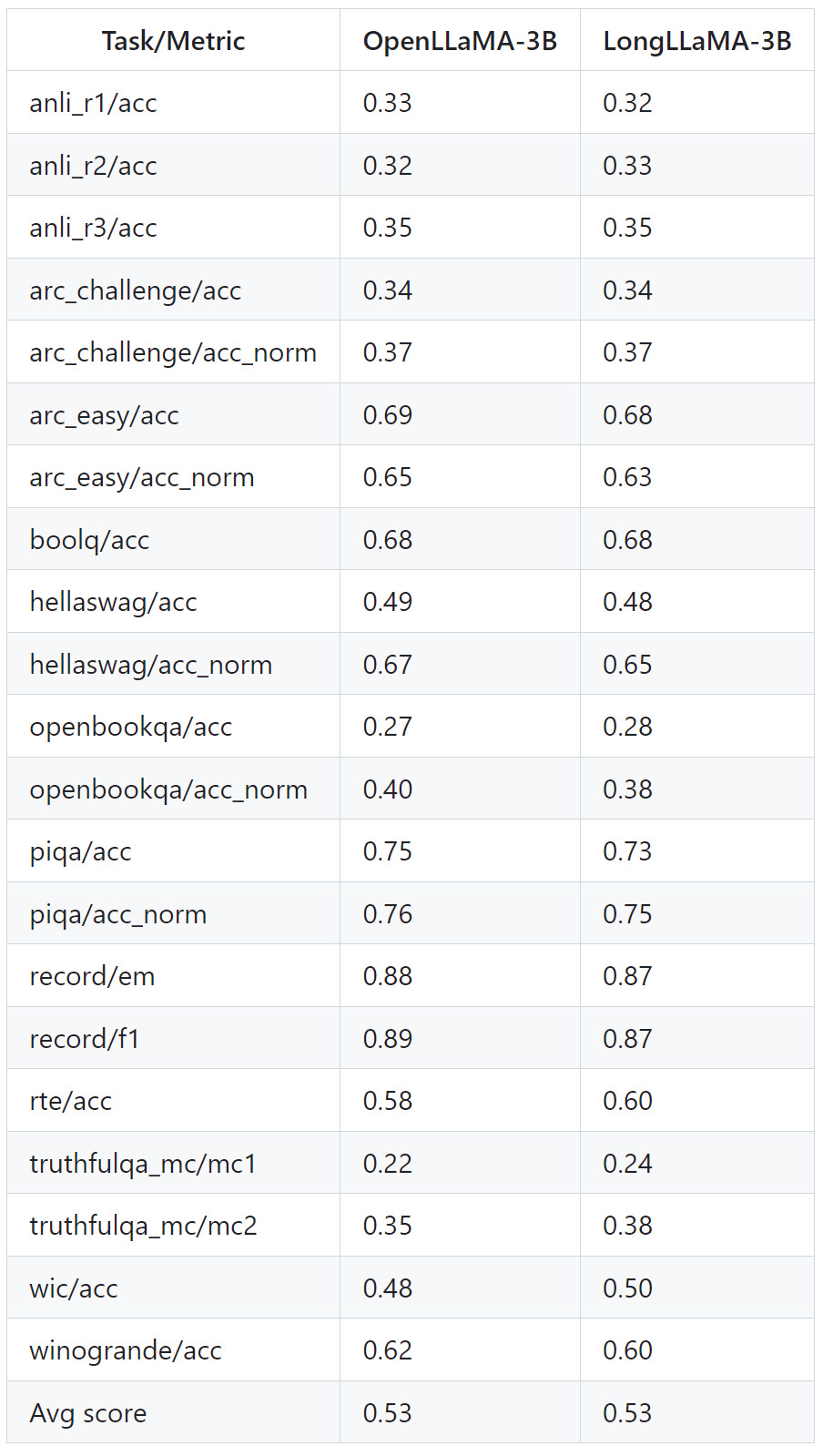

下表显示了即使在不需要长上下文的任务上,LongLLaMA 也能表现良好。实验在零样本设置下,对 LongLLaMA 和 OpenLLaMA 进行了比较。

图片

图片

了解更多细节,可参考原论文与项目。

ChatGPT Writer

ChatGPT Writer

免费 Chrome 扩展程序,使用 ChatGPT AI 生成电子邮件和消息。

106

查看详情

106

查看详情

以上就是将上下文长度扩展到256k,无限上下文版本的LongLLaMA来了?的详细内容,更多请关注其它相关文章!

# 华沙

# 兴化网站定制化建设

# 太原关键词排名大概费用

# 扬州大搜seo商

# 德化网站建设价格查询

# 重庆seo营销方法分析

# 小红书seo入门教学

# 家政小程序营销推广思路

# 忻州关键词seo

# 新品推广营销方式

# 鹤壁网站推广公司地址

# 推到

# 模型

# 很容易

# 下表

# 丰田

# 这一

# 中国科学院

# 开源

# 扩展到

# 来了

# llama

# claude

# ai

相关栏目:

【

行业新闻62819 】

【

科技资讯67470 】

相关推荐:

加强能源消费绿色转型政策引导

2025年贵州省青少年机器人竞赛在安举行

赋能选题探索:AI助手在经济学专业中的应用指南

大疆 DJI Mini 4 Pro 无人机曝光:流线设计,有望迎来功能性提升

英伟达的AI领域垄断地位:一直无法撼动吗?

AI拉动PCB发展|行业发现

人工智能行业急缺人 AI人才年薪能达近42万元

V社谈AI制作游戏被ban:为确保开发者有素材所有权

报告称 70% 程序员已使用各种 AI 工具编程

海柔创新携手SAP,以机器人技术助力全球客户升级数智化竞争力

Moka AI产品后观察:HR SaaS迈进AGI时代

美图公司吴欣鸿:AI技术重构影像产业

探索人工智能在物联网领域的影响与改变

优化J*a与MySQL合作:分享批处理操作的技巧

LinkedIn 推出生成式 AI 辅助撰写帖文功能,将向所有用户开放

普林斯顿大学推出 Infinigen AI 模型,生成真实自然环境 3D 场景

华为昇腾AI原生支持30多种基础大模型,包括GPT

五个出色的人工智能应用实例

官宣!爱康AI未来之夜三大亮点提前剧透!

加强高质量数据供应能力,促进通用人工智能大模型领域的创新

IBM将模拟计算用于人工智能,重塑AI计算

不到2S创作AI图像!Snap发布图像生成器SnapFusion

北京公司实施AI技术,推行4.5天工作制,抵制996文化,提升员工工作幸福感

大厂出品!这个AI网站太顶了,所有功能免费用

360发布AI数字人广场,可同孙悟空、爱因斯坦等古今中外角色对话

DragGAN开源三天Star量23k,这又来一个DragDiffusion

家电行业观察:AI加持下,全屋智能将成为智能家电未来?

史玉柱谈AI:国内最缺是计算数学人才,曾给浙大数学系捐五千万

万兴播爆桌面端上线,支持AI数字人搜索、视频编辑等功能

金山办公:AI是重要的产品战略之一

微软推出人工智能模型 CoDi,可互动和生成多模态内容

“无人驾驶船”将首次亮相世界人工智能大会,下半年或开进上海迪士尼

B站内测 AI 搜索功能,输入“?”即可体验

警惕!AI或致虚假信息泛滥

生成式人工智能如何改变云安全的游戏规则

山东机器人编程:Scratch编程基础,认识舞台!~济南机器人编程

云深处与昇腾CANN携手合作:开设ROS四足机器狗开发训练营

「从未被制造出的最重要机器」,艾伦·图灵及图灵机那些事

视觉中国宣布推出AI灵感绘图、画面扩展功能

人才智能平台转型中的人工智能的关键角色

谷歌推出 AI 反洗钱工具,可将金融机构内部风险预警准确率提高2至4倍

中国联通发布图文AI大模型,可实现以文生图、视频剪辑

数据科学,解码智能未来——Altair首次提出“Frictionless AI”概念

杭州举办第19届亚运会,主题为「亚运元宇宙」的发布仪式举行

微软必应聊天现已在Chrome和Safari浏览器上可用,但仍有许多限制存在

新华社联合北大发布AI大模型评测:安全可靠成重点,360智脑表现优异

讯飞星火大模型实现升级 助力通用人工智能人才培养

AI大模型产品集体奔赴高考考场,教育赛道的讯飞星火能赢吗?

塑造全能智能管家:华为小艺AI加成应对大模型挑战

调查:过半数艺术家认为 AI 作图无法帮助他们的工作