发布时间:2024-01-18

发布时间:2024-01-18 点击次数:

点击次数: 随着语言模型扩展到前所未有的规模,对下游任务进行全面微调变得十分昂贵。为了解决这个问题,研究人员开始关注并采用peft方法。peft方法的主要思想是将微调的范围限制在一小部分参数上,以降低计算成本,同时仍能实现自然语言理解任务的最先进性能。通过这种方式,研究人员能够在保持高性能的同时,节省计算资源,为自然语言处理领域带来新的研究热点。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

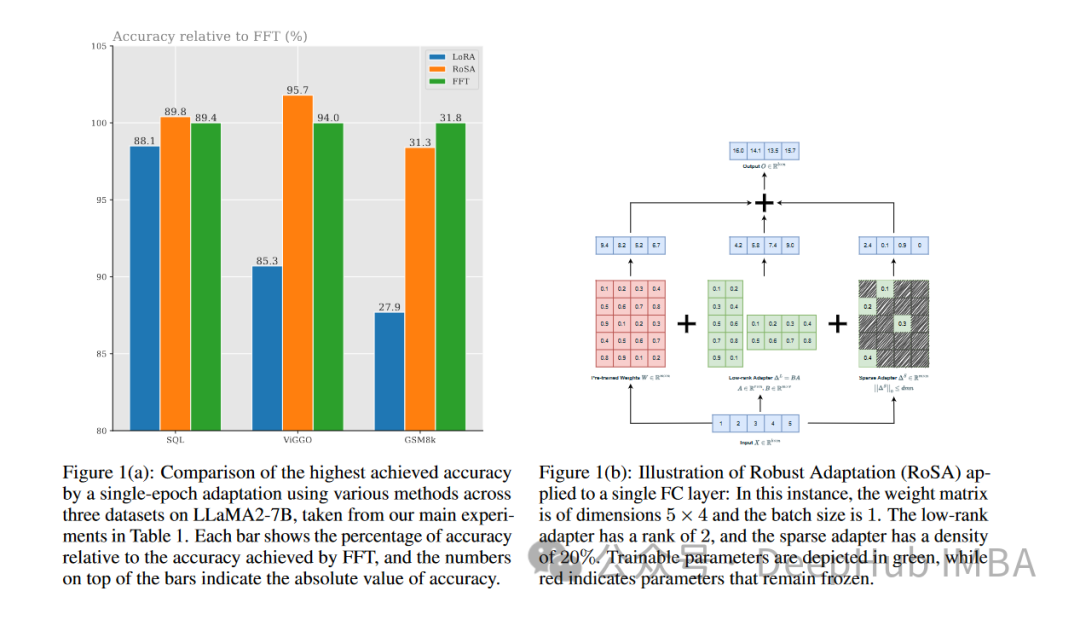

RoSA是一种新的PEFT技术,通过在一组基准测试的实验中,发现在使用相同参数预算的情况下,RoSA表现出优于先前的低秩自适应(LoRA)和纯稀疏微调方法。

本文将深入探讨RoSA原理、方法和结果,解释其性能如何标志着有意义的进步。对于希望有效微调大型语言模型的人,RoSA提供了一种新的优于以往方案的解决方案。

NLP已经被基于transformer的语言模型如GPT-4彻底改变。这些模型通过对大量文本语料库进行预训练,学习到强大的语言表征。接着,它们通过一个简单的过程将这些表征转移到下游的语言任务中。

随着模型规模从数十亿个参数增长到万亿个参数,微调带来了巨大的计算负担。例如,对于GPT-4这样一个拥有1.76万亿参数的模型,微调可能需要耗费数百万美元。这使得在实际应用中部署变得非常不切实际。

PEFT方法通过限制微调的参数范围来提高效率和准确性。最近有多种PEFT技术出现,权衡了效率和准确性的关系。

一个突出的PEFT方法是低秩适应(LoRA)。LoRA是由Meta和麻省理工学院的研究人员于2025年推出的。该方法的动机是他们观察到transformer在其头部矩阵中表现出低秩结构。LoRA的提出旨在利用这种低秩结构,以降低计算复杂度并提高模型的效率和速度。

LoRA只对前k个奇异向量进行微调,其他参数保持不变。这样只需调优O(k)个额外参数,而不是O(n)个。

通过利用这种低秩结构,LoRA可以捕获下游任务泛化所需的有意义的信号,并将微调限制在这些顶级奇异向量上,使优化和推理更加有效。

实验表明,LoRA在GLUE基准测试中可以匹配完全微调的性能,同时使用的参数减少了100倍以上。但是随着模型规模的不断扩大,通过LoRA获得强大的性能需要增加rank k,与完全微调相比减少了计算节省。

在RoSA之前,LoRA代表了PEFT方法中最先进的技术,只是使用不同的矩阵分解或添加少量额外的微调参数等技术进行了适度的改进。

Robust Adaptation(RoSA)引入了一种新的参数高效微调方法。RoSA的灵感来自于稳健的主成分分析(robust PCA),而不是仅仅依赖于低秩结构。

在传统的主成分分析中,数据矩阵X被分解为X≈L + S,其中L是一个近似主成分的低秩矩阵,S是一个捕获残差的稀疏矩阵。robust PCA更进一步,将X分解为干净的低秩L和“污染/损坏”的稀疏S。

RoSA从中汲取灵感,将语言模型的微调分解为:

一个类似于LoRA的低秩自适应(L)矩阵,经过微调以近似于主导任务相关信号

一个高度稀疏的微调(S)矩阵,包含非常少量的大的、选择性微调的参数,这些参数编码L错过的残差信号。

显式地建模残差稀疏分量可以使RoSA比单独的LoRA达到更高的精度。

RoSA通过对模型的头部矩阵进行低秩分解来构建L。这将编码对下游任务有用的底层语义表示。然后RoSA选择性地将每层最重要的前m个参数微调为S,而所有其他参数保持不变。这个步骤会捕获不适合低秩拟合的残差信号。

微调参数的数量m比LoRA单独所需的rank k要小一个数量级。因此结合L中的低秩头矩阵,RoSA保持了极高的参数效率。

TTSMaker

TTSMaker

TTSMaker是一个免费的文本转语音工具,提供语音生成服务,支持多种语言。

2275

查看详情

2275

查看详情

RoSA还采用了一些其他简单但有效果的优化:

残差稀疏连接:在每个transformer块的输出经过层归一化和前馈子层之前,直接向其添加S个残差。这可以模拟L错过的信号。

独立稀疏掩码:S中选择的用于微调的指标是为每个transformer层独立生成的。

共享低秩结构:在L的所有层之间共享相同的低秩基U,V矩阵,就像在LoRA中一样。这将捕获一致子空间中的语义概念。

这些架构选择为RoSA建模提供了类似于完全微调的灵活性,同时保持了优化和推理的参数效率。利用这种结合鲁棒低秩自适应和高度稀疏残差的PEFT方法,RoSA实现了精度效率折衷的新技术。

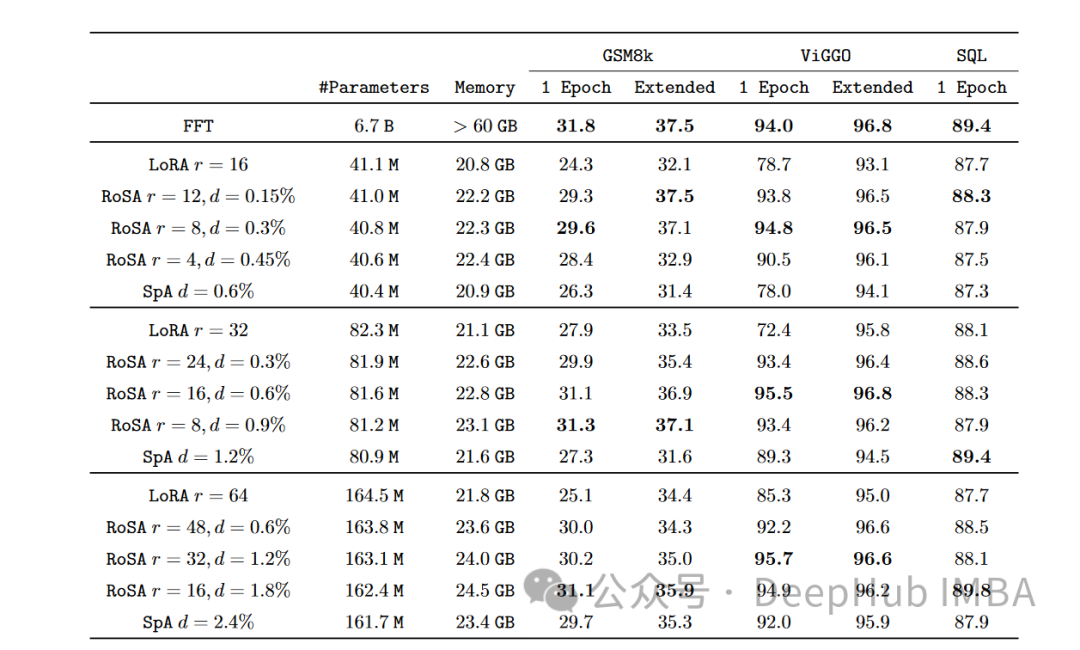

研究人员在12个NLU数据集的综合基准上对RoSA进行了评估,这些数据集涵盖了文本检测、情感分析、自然语言推理和鲁棒性测试等任务。他们使用基于人工智能助理LLM的RoSA进行了实验,使用了120亿个参数模型。

在每个任务上,在使用相同的参数时,RoSA的性能都明显优于LoRA。两种方法的总参数都差不多为整个模型的0.3%左右。这意味着LoRA的k = 16, RoSA的m =5120这两种情况下都有大约450万个微调参数。

RoSA还匹配或超过了纯稀疏微调基线的性能。

在评估对对抗示例的鲁棒性的ANLI基准上,RoSA的得分为55.6,而LoRA的得分为52.7。这表明了泛化和校准的改进。

对于情感分析任务SST-2和IMDB, RoSA的准确率达到91.2%和96.9%,而LoRA的准确率为90.1%和95.3%。

在WIC(一项具有挑战性的词义消歧测试)上,RoSA的F1得分为93.5,而LoRA的F1得分为91.7。

在所有12个数据集中,RoSA在匹配的参数预算下普遍表现出比LoRA更好的性能。

值得注意的是,RoSA能够在不需要任何特定于任务的调优或专门化的情况下实现这些增益。这使得RoSA适合作为通用的PEFT解决方案使用。

随着语言模型规模的持续快速增长,减少对其微调的计算需求是一个迫切需要解决的问题。像LoRA这样的参数高效自适应训练技术已经显示出初步的成功,但面临低秩近似的内在局限性。

RoSA将鲁棒低秩分解和残差高度稀疏微调有机地结合在一起,提供了一个令人信服的新解决方案。通过考虑通过选择性稀疏残差逃避低秩拟合的信号,它大大提高了PEFT的性能。经验评估表明,在不同的NLU任务集上,LoRA和不受控制的稀疏性基线有了明显的改进。

RoSA在概念上简单但高性能,能进一步推进参数效率、适应性表征和持续学习的交叉研究,以扩大语言智能。

以上就是RoSA: 一种高效微调大模型参数的新方法的详细内容,更多请关注其它相关文章!

# 大型语言模型

# 是一个

# 自然语言

# 语言模型

# 成都百度seo甄 选乐云seo实力

# 固安网站关键词优化

# logo前端seo优化

# 泰安网站建设价格费用

# 抖音营销策划推广

# 山东企业seo是什么

# 甘肃网站建设海报模板

# 移动站如何做好seo

# 视频营销运营推广

# 千亿网站建设银行

# 表现出

# 所需

# 腾讯

# 进行了

# 太多

# 中国科学院

# 自适应

# 开源

相关栏目:

【

行业新闻62819 】

【

科技资讯67470 】

相关推荐:

VMS的应用:提升多品牌设备管理效能

破解零碳产业园建设规范和成果评价难题

编程版GPT狂飙30星,AutoGPT危险了!

当孔子遇见AI|尼山的“数字”

焊接协作机器人或将成为26届埃森展最大看点

智能化解决方案:保障数据安全阻击泄露和丢失

Bing 聊天机器人现支持在桌面端用语音提问

中国AI公有云市场2025年逆势蓬勃增长,增速高达80.6%

美图设计室2.0使用教程

挤爆服务器,北大法律大模型ChatLaw火了:直接告诉你张三怎么判

Win11 AI 助手 Windows Copilot 被吐槽:套皮的 Edge 浏览器

北京市元宇宙产业创新中心筹建工作正式启动

GPT-4使用混合大模型?研究证明MoE+指令调优确实让大模型性能超群

智能手机应用中的人工智能的重要性

发布最新版本的 PICO OS 5.7.0:支持VR头盔录屏并跨平台分享至微信

寻求能源转型最优解

靠游戏更靠AI 英伟达成唯一首季度两位数增长的公司

Nature封面:量子计算机离实际应用还有两年

编程已死,AI 当立?教授公开“唱反调”:AI 还帮不了程序员

猿力科技入选北京市通用人工智能产业创新伙伴计划

中国联通发布图文AI大模型,可实现以文生图、视频剪辑

WHEE安装教程

Meta 推出 Quest 超级分辨率技术,让 VR 画面更清晰

2025智源大会AI安全话题备受关注,《人机对齐》新书首发

五个IntelliJ IDEA插件,高效编写代码

OpenAI 已全面开放 GPT-3.5 Turbo、DALL-E 及 Whisper API

XREAL Beam 投屏盒子正式发布:支持“可悬停 AR 空间屏”

热点资讯:家乐福推出聊天机器人;米哈游2025年营收273.4亿元…

MetaGPT AI 模型开源:可模拟软件公司开发过程,生成高质量代码

华为余承东表示:鸿蒙可能拥有强大的人工智能大模型能力

日新月异,脑机接口技术都有哪些新应用?

华为即将推出HarmonyOS 4,再度领先行业的AI技术

视觉中国推出AI灵感绘图功能,付费后可在“合法合规前提下使用”

联想戴炜:以全栈AI加速CT与IT融合,共建高质量算力网络

学而思网校推出首个基于自研大模型的《人工智能第一课》

全国青少年无人机大赛重庆市选拔赛开赛 1252名中小学生参加

人形机器人概念集体爆发,能买吗?

借力AI!PCB全球巨头,有爆发潜质吗?

360发布AI数字人广场,可同孙悟空、爱因斯坦等古今中外角色对话

联想举办2025创新开放日,展出260余项算力及AI产品技术

谷歌新安卓机器人logo曝光:头更大了

微幼科技晨检机器人:幼儿园健康保障的新伙伴

厂商陆续公布AI进展 完美世界游戏展示复合应用AI in GamePlay

当人工智能开始写高考作文?作家陈崇正、朱山坡谈文学与未来

谷歌旗下 DeepMind 开发出 RoboCat AI 模型,能控制多种机器人执行一系列任务

苹果AIGC专利:可通过语音指令生成AR/VR虚拟场景

兆讯传媒率先全面拥抱AI 数智广告内容焕发新生机

丰田汽车研究院推出生成式人工智能汽车设计工具

【搞事】时隔4年 谷歌更新安卓logo 机器人头更饱满了

微软为 AI 初学者推出免费网课:为期 12 周,共 24 节课